El rápido desarrollo de la inteligencia artificial está generando una alarma creciente entre investigadores y organismos internacionales. Según proyecciones de la Agencia Internacional de Energía, los centros de datos destinados a sostener la IA podrían absorber hasta el 20% del consumo eléctrico mundial para 2035, lo que supone un desafío ambiental sin precedentes.

Este escenario se explica por la naturaleza de los modelos de IA actuales, que requieren entrenar miles de millones de parámetros en procesos repetidos. Cada entrenamiento demanda una infraestructura de alto rendimiento con miles de GPU y TPU funcionando en paralelo durante meses, lo que incrementa de forma exponencial el gasto energético. Los modelos de "razonamiento" más avanzados consumen hasta 43 veces más energía que los sistemas simples.

Además del consumo eléctrico, la IA también representa un desafío hídrico crítico. Estudios de la Universidad de Illinois estiman que, para 2027, los sistemas de inteligencia artificial podrían requerir entre 4.2 y 6.6 mil millones de metros cúbicos de agua al año para refrigeración, superando en seis veces el consumo de un país como Dinamarca y compitiendo directamente con el agua potable.

El problema se agrava con la producción masiva de desechos electrónicos. Según investigaciones publicadas en Nature Computational Science, la corta vida útil de las tarjetas gráficas y chips utilizados en centros de datos podría generar hasta 2.5 millones de toneladas de residuos anuales en 2030, un volumen comparable al desecho de 13 mil millones de teléfonos inteligentes cada año.

Los investigadores del MIT Lincoln Laboratory señalan que este ritmo de renovación tecnológica no solo desperdicia enormes cantidades de energía invertidas en entrenamientos previos —ya que las empresas lanzan nuevos modelos cada pocas semanas—, sino que también alimenta un mercado dependiente de la extracción de minerales raros, cuyos procesos impactan gravemente en los ecosistemas y comunidades locales.

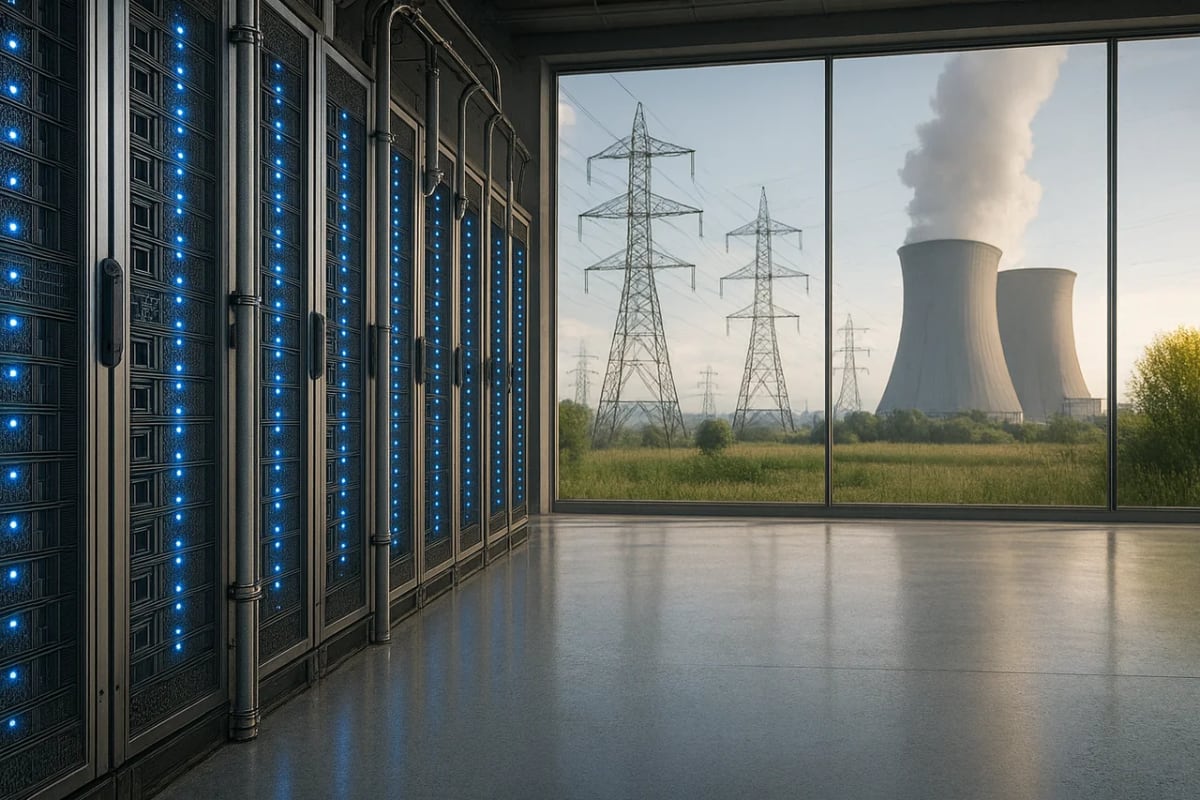

El crecimiento de la IA está provocando también consecuencias geopolíticas inmediatas. Países como Estados Unidos han tenido que retrasar el cierre de plantas de carbón o reactivar antiguos reactores nucleares para abastecer la creciente demanda de electricidad por parte de los gigantes tecnológicos, mientras que el 80% del consumo energético de la IA proviene de la fase de inferencia, no del entrenamiento.

La presión sobre las redes eléctricas genera además tensiones entre gobiernos y compañías de energía, ya que el aumento de los costos de producción amenaza con trasladarse a los consumidores y comprometer los objetivos internacionales de reducción de emisiones de carbono establecidos en acuerdos como el de París.

Frente a este panorama, algunas soluciones avaladas por organizaciones como el Programa de las Naciones Unidas para el Medio Ambiente comienzan a ganar terreno. La construcción de centros de datos en regiones con abundancia de energías renovables, así como la reutilización de servidores obsoletos para tareas menos exigentes o su donación a instituciones educativas, aparecen como alternativas viables para reducir el impacto.

La aplicación de técnicas de "limitación energética", desarrolladas por investigadores del MIT, que consisten en restringir el suministro eléctrico a los procesadores para reducir temperaturas y consumo, podría recortar entre un 12% y un 15% la huella energética de los modelos de IA, con un impacto mínimo del 3% en los tiempos de procesamiento.

Sin embargo, los expertos advierten que estas medidas serán insuficientes si no se integran en un marco regulatorio global. La ausencia de políticas que equilibren innovación tecnológica y sostenibilidad —como las que ya están implementando la Unión Europea y algunos estados de Estados Unidos— amenaza con convertir el auge de la inteligencia artificial en una crisis ambiental irreversible.