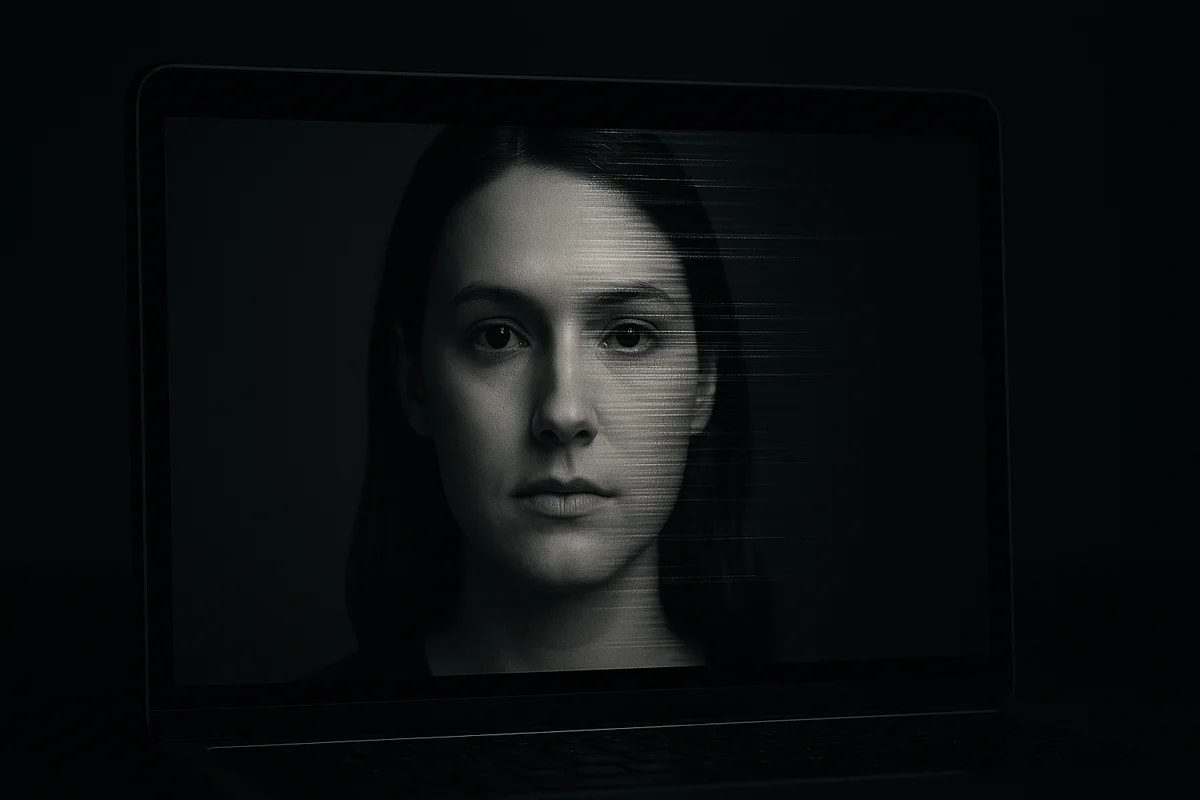

Cinco minutos pueden marcar la diferencia entre dejarse engañar por un rostro generado por inteligencia artificial o detectarlo a simple vista. Un estudio de la Universidad de Reading, en colaboración con las universidades de Greenwich, Leeds y Lincoln, ha demostrado que un entrenamiento ultracorto mejora de forma notable la capacidad humana para distinguir imágenes reales de las creadas por software como StyleGAN3, uno de los sistemas de generación de rostros más avanzados.

El equipo analizó a más de 660 participantes que debían identificar si las imágenes mostraban personas reales o sintéticas. Sin ningún tipo de preparación, los resultados fueron mediocres: quienes tenían buena memoria visual acertaron solo el 41 % de las veces, mientras que el resto apenas llegó al 31 %. En la práctica, eso significa que incluso los observadores más hábiles se equivocan más de la mitad de las veces al enfrentarse a rostros falsos generados por IA.

Un entrenamiento de cinco minutos que marca la diferencia

El grupo de control recibió un breve entrenamiento visual que explicaba cómo reconocer errores comunes en las imágenes sintéticas: cabellos con patrones repetidos, ojos asimétricos, dientes mal formados o fondos ligeramente distorsionados. Tras solo cinco minutos de práctica, los resultados cambiaron drásticamente. Los llamados “superreconocedores” lograron una precisión del 64 %, mientras que los participantes promedio alcanzaron el 51 %, un salto notable en comparación con el azar.

“La diferencia puede parecer pequeña, pero es estadísticamente significativa y demuestra que el ojo humano puede entrenarse para detectar señales sutiles de falsificación”, explicó la doctora Katie Gray, autora principal del estudio. “Nuestro procedimiento es breve y fácil de implementar, pero puede tener aplicaciones reales en la verificación de identidades y la detección de fraudes digitales”.

La delgada línea entre lo real y lo sintético

Los rostros generados por inteligencia artificial se utilizan cada vez más en contextos de riesgo: desde perfiles falsos en redes sociales y campañas de desinformación, hasta documentos de identidad manipulados. Según Gray, la precisión de los modelos de IA es ya tan alta que muchas personas los consideran incluso más “realistas” que los rostros auténticos.

El avance plantea nuevos desafíos para la seguridad digital y la confianza en la imagen como prueba. Los investigadores planean evaluar cuánto tiempo perdura el efecto del entrenamiento y si puede combinarse con sistemas automáticos de detección. “Comprender cómo el cerebro humano reacciona ante lo sintético es clave para diseñar herramientas que nos protejan en un entorno donde la frontera entre lo real y lo falso se difumina”, concluyó Gray.

El estudio, publicado en Royal Society Open Science, abre una nueva línea de trabajo entre la psicología cognitiva y la inteligencia artificial: enseñar a las personas a ver con un ojo más crítico en la era de las imágenes perfectas pero irreales.

Fuente: Royal Society Open Science