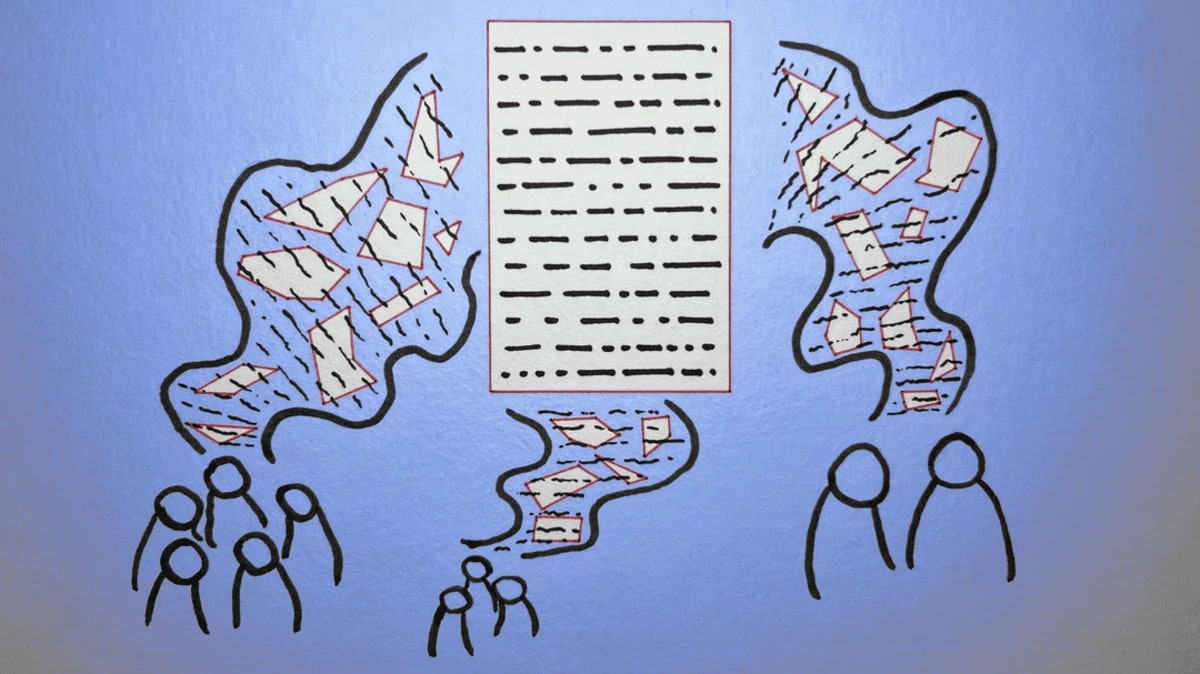

Los modelos de lenguaje como ChatGPT, DeepSeek y Claude están transformando la manera en que se accede a la información científica, pero un nuevo estudio advierte que estos sistemas de IA exageran rutinariamente los hallazgos de los estudios que resumen. La investigación, liderada por el Dr. Uwe Peters de la Universidad de Utrecht y el Dr. Benjamin Chin-Yee, evaluó 4.900 resúmenes generados por 10 modelos de lenguaje masivo (LLM) y encontró que seis de ellos incurrieron en generalizaciones excesivas en la mayoría de los casos.

El análisis incluyó resúmenes de artículos científicos de alto impacto publicados en revistas como Nature, Science y Lancet. Los modelos tendían a convertir frases cautelosas como “el tratamiento fue eficaz en este estudio” en afirmaciones absolutas como “el tratamiento es eficaz”, ampliando erróneamente el alcance de los resultados originales.

Paradójicamente, cuando se les pidió expresamente que evitaran inexactitudes, algunos modelos generaron aún más exageraciones. “Esto es preocupante”, señaló Peters, “porque sugiere que los usuarios podrían confiar más en resúmenes que en realidad son menos precisos cuando se intenta mejorar su fidelidad”.

Los investigadores también compararon estos resúmenes con versiones escritas por humanos. Los chatbots presentaron una probabilidad casi cinco veces mayor de exagerar las conclusiones científicas. Los modelos más nuevos, como ChatGPT-4o y DeepSeek, resultaron menos precisos que versiones anteriores, desafiando la noción de que las mejoras técnicas implican mayor rigor.

El estudio destaca que este comportamiento puede estar vinculado a los propios datos de entrenamiento: “Las generalizaciones excesivas ya son comunes en la escritura científica, y los modelos podrían estar reproduciendo ese sesgo”, explicó Chin-Yee. Además, los usuarios podrían fomentar sin querer estas exageraciones al preferir respuestas más amplias o contundentes.

Para reducir estos riesgos, los autores recomiendan usar modelos como Claude, que mostró mejores niveles de precisión, así como ajustar la temperatura de los LLM (parámetro que regula la creatividad) y fomentar el uso de tiempo pasado y lenguaje indirecto en los resúmenes generados.

“Si queremos que la inteligencia artificial potencie la alfabetización científica y no la debilite, necesitamos implementar evaluaciones de precisión rigurosas en estos sistemas”, concluyó Peters. El artículo completo se encuentra publicado en Royal Society Open Science.

Referencias: Royal Society Open Science