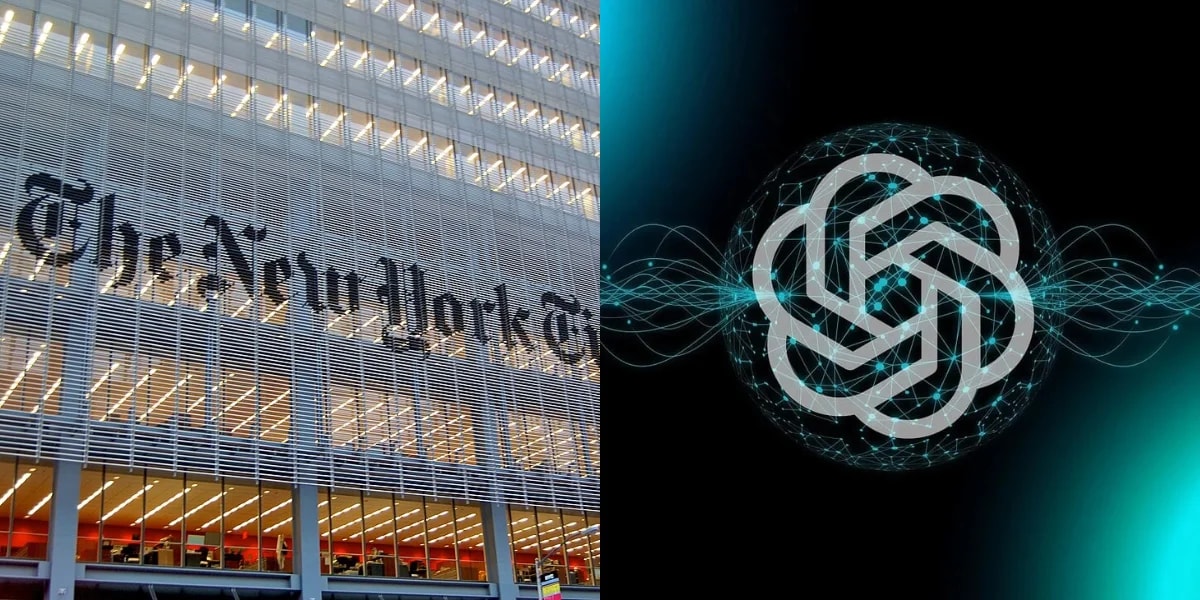

La controversia en torno al uso y la protección de los datos generados por inteligencia artificial ha alcanzado un nuevo nivel tras la orden judicial promovida por The New York Times. El medio estadounidense, en el marco de una demanda en curso, solicitó que OpenAI conserve de forma indefinida todos los registros generados por usuarios en ChatGPT y a través de su API, incluyendo conversaciones y archivos que normalmente serían eliminados pasados 30 días. Esta decisión marca un quiebre respecto a las prácticas habituales del sector tecnológico, donde la eliminación periódica de datos es vista como un estándar de privacidad.

OpenAI, la compañía detrás de ChatGPT, manifestó públicamente su rechazo a esta exigencia, señalando que contradice los compromisos de privacidad asumidos con sus usuarios y va en contra de las normas consolidadas en la industria. Según la empresa, la obligación de retener indefinidamente incluso los datos que los propios usuarios han borrado representa un riesgo para la protección de la información personal y podría entrar en conflicto con regulaciones internacionales como el GDPR europeo.

La medida afecta a la mayoría de los usuarios de ChatGPT —tanto en sus versiones gratuitas como de pago (Free, Plus, Pro y Team)— y a los clientes de la API que no cuenten con acuerdos específicos de retención cero de datos. Quedan exceptuados los usuarios empresariales con el acuerdo ZDR (Zero Data Retention) y los clientes de ChatGPT Enterprise y Edu. Los datos cubiertos por la orden se almacenan en un sistema seguro bajo retención legal y solo pueden ser accedidos por un pequeño grupo de personal autorizado, sujeto a auditorías y protocolos estrictos.

OpenAI ha iniciado acciones legales para impugnar la decisión, argumentando que la obligación es excesivamente amplia y perjudicial para sus políticas internas. Durante una audiencia reciente, el tribunal confirmó que los clientes empresariales de ChatGPT Enterprise no están sujetos a la retención indefinida, pero la orden sigue vigente para el resto de los servicios. La empresa enfatiza que estos datos no se comparten automáticamente con The New York Times ni con terceros, y únicamente pueden ser utilizados para cumplir obligaciones legales.

Sam Altman, CEO de OpenAI, expresó su preocupación sobre el precedente que esta situación podría sentar en la industria tecnológica y remarcó la importancia de abrir un debate público sobre los límites legales y éticos del acceso a la información generada por inteligencia artificial. Según la postura oficial, cumplir la orden judicial es una obligación temporal mientras se resuelve la apelación, pero el objetivo de la empresa es volver a sus prácticas habituales de eliminación automática de datos si el tribunal falla a su favor.

El caso ha reavivado el debate internacional sobre los derechos digitales, la privacidad en la era de la IA y el papel de los tribunales en la protección de los datos personales frente a los intereses comerciales, judiciales o mediáticos. Mientras tanto, OpenAI mantiene su compromiso de transparencia con los usuarios, asegurando que informará sobre cualquier cambio relevante en sus políticas de datos.