En un innovador experimento, investigadores de la Universidad de Constanza han logrado descifrar la lógica que utilizan los peces cebra para coordinarse en cardúmenes, gracias a un sistema de realidad virtual tridimensional. El descubrimiento permitió desarrollar una "ley de control" que ya se ha implementado con éxito en robots móviles, incluidos drones, coches y barcos.

El estudio, publicado en Science Robotics, revela cómo los peces no necesitan líderes ni reglas complejas para moverse en armonía. Utilizan únicamente la posición visual de sus congéneres para mantener la cohesión del grupo, lo que inspiró a los científicos a adaptar esta lógica en sistemas robóticos autónomos.

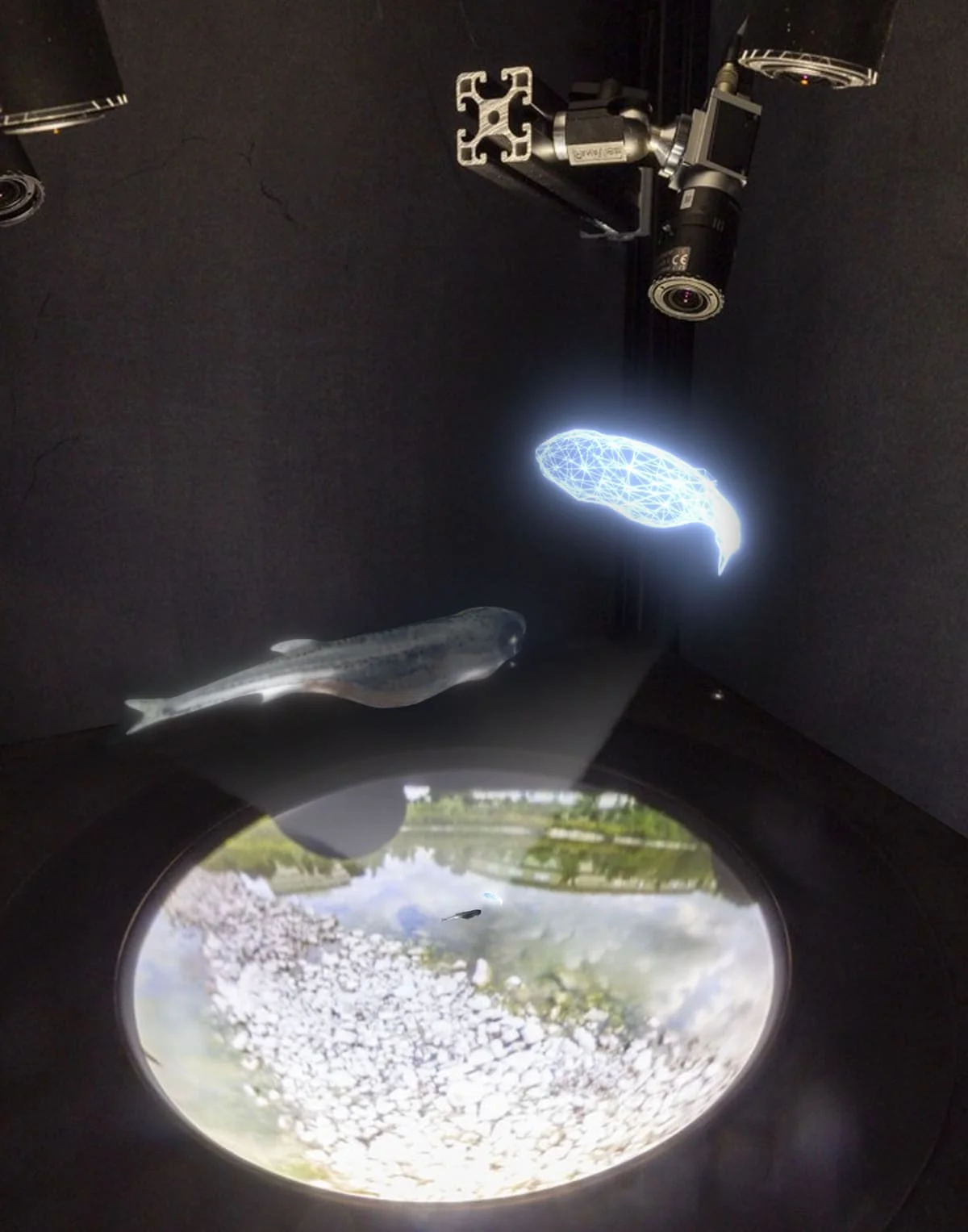

En el experimento, peces reales interactuaban en arenas conectadas mediante realidad virtual con proyecciones holográficas de otros peces. Esta simulación les permitió replicar con precisión la dinámica natural del cardumen y analizar cómo los peces responden a estímulos visuales.

La clave fue una regla sencilla pero efectiva: los peces no se fijan en la velocidad de los demás, solo en sus posiciones relativas. Con esta información mínima, logran coordinar movimientos complejos sin colisiones ni desorganización. "Es una ley cognitivamente mínima pero funcionalmente excelente", dijo Iain Couzin, líder del proyecto.

Para verificar su validez, los investigadores realizaron una prueba de Turing en realidad virtual. Un pez nadaba con una proyección controlada por el algoritmo derivado de sus congéneres. ¿El resultado? El pez no detectó diferencia alguna. Respondía igual ante el pez real que ante el modelo computacional.

Posteriormente, el algoritmo fue implementado en enjambres de robots de distintas plataformas. El desempeño fue sorprendentemente similar al de los sistemas de control predictivo más avanzados, pero con menor consumo energético y mucha menor complejidad computacional.

Oliver Deussen, coautor del estudio, afirma que este hallazgo marca una reciprocidad entre biología y robótica. "Usamos robots para entender mejor a los animales, y luego usamos lo aprendido para diseñar máquinas más inteligentes y adaptativas".

El trabajo involucró a instituciones líderes como el Instituto Max Planck de Comportamiento Animal, la Universidad de Eötvös (Hungría) y el MIT (EE. UU.). Además, recibió apoyo de programas europeos, la DFG alemana y fundaciones privadas como la Werner y Erika Messmer Stiftung.

Referencias: Science Robotics (DOI: 10.1126/scirobotics.adq6784)